Một số công ty trong đó có Microsoft і Facebook, và thậm chí các nhà nghiên cứu từ Đại học Nam California, đang phát triển các công nghệ để chống lại deepfakes và ngăn chặn sự lây lan của chúng bởi phương tiện màu vàng và thông tin sai lệch nói chung. Tuy nhiên, một nhóm các nhà khoa học vẫn lừa được họ.

Một nhóm các nhà khoa học máy tính tại Đại học California, San Diego đã cảnh báo rằng vẫn có thể đánh lừa các hệ thống phát hiện deepfake hiện có bằng cách chèn dữ liệu đầu vào được gọi là "ví dụ cạnh tranh" vào mỗi khung hình video. Các nhà khoa học đã trình bày phát hiện của họ tại Hội nghị Thị giác Máy tính WACV 2021, được tổ chức trực tuyến vào tháng trước.

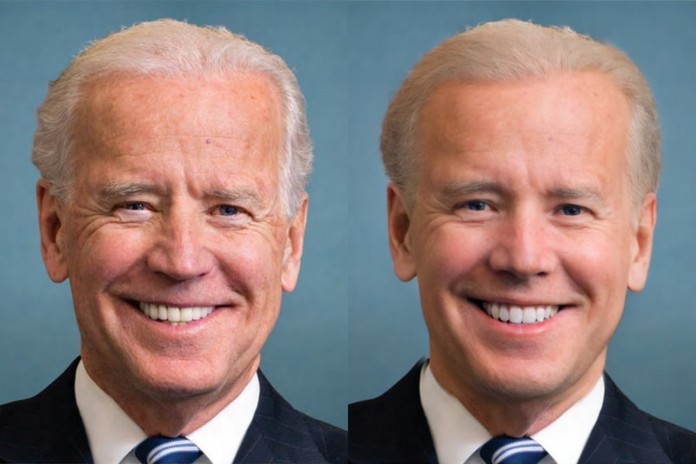

Các ví dụ cạnh tranh là các đầu vào bị thay đổi một chút khiến các hệ thống trí tuệ nhân tạo, chẳng hạn như các mô hình máy học, mắc lỗi. Ngoài ra, nhóm đã chỉ ra rằng cuộc tấn công vẫn hoạt động sau khi nén video. Trong video trên, các nhà khoa học cho thấy XceptionNet, một công cụ phát hiện deepfake, gắn nhãn video cạnh tranh của họ là "thật".

Hầu hết các máy dò này hoạt động bằng cách theo dõi khuôn mặt trong video và gửi dữ liệu khuôn mặt đã cắt tới mạng thần kinh để phân tích. Sau đó, mạng thần kinh sẽ phân tích dữ liệu này và tìm ra các yếu tố thường được tái tạo kém trong các tác phẩm sâu, chẳng hạn như nhấp nháy.

Bằng cách chèn các ví dụ cạnh tranh, các nhà nghiên cứu nhận thấy rằng họ có thể đánh lừa những máy dò deepfake này tin rằng các video là có thật.

Họ tuyên bố trong bài báo rằng “để sử dụng các công cụ phát hiện deepfake này trong thực tế, điều quan trọng là phải đánh giá chúng trước một kẻ thù thích nghi nhận thức được sự bảo vệ này và cố tình phá vỡ nó. Chúng tôi cho thấy rằng các phương pháp phát hiện deepfake hiện đại có thể dễ dàng bị bỏ qua nếu kẻ tấn công nhận thức được hoàn toàn hoặc thậm chí một phần về trình phát hiện."

Như các nhà khoa học này đã chỉ ra, các công nghệ tự động hóa đang được phát triển để chống lại thông tin sai lệch có thể chưa đáp ứng được nhiệm vụ.

Đọc thêm: